O Discord está a trabalhar em novas ferramentas para proteger menores na sua plataforma e começou a lançar um novo mecanismo experimental.

Após vários escândalos que acabaram por envolver indiretamente o Discord, a plataforma vai apertar as regras de controlo e proteção dos mais jovens. O famoso chat de voz adicionou uma nova alínea na sua secção de perguntas e respostas após vários utilizadores começarem a reportar um novo tipo de verificação de idade que revela o teste de um sistema inédito neste tipo de plataforma.

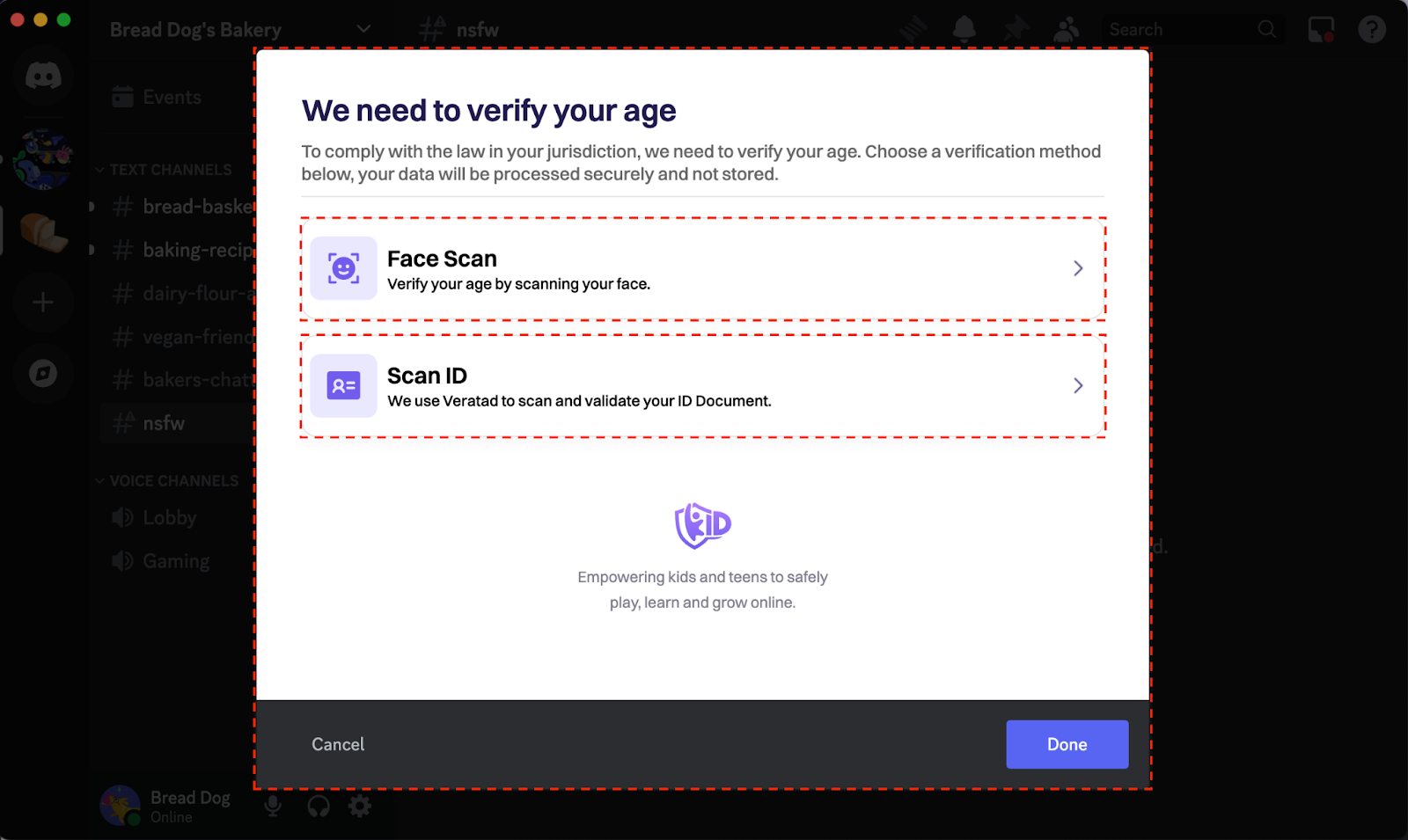

Os jogadores e utilizadores do Discord têm agora de passar um processo de verificação de idade para terem acesso a conteúdos sensíveis. Esta verificação tem de ser feita uma vez para validar a conta como pertencendo a um adulto e envolve passos específicos.

Os utilizadores têm de fazer uma verificação da cara através de reconhecimento facial com recurso às suas Webcams, ou então fazer Upload de uma cópia do seu documento de identificação. Depois de verificados como adultos, podem assistir a tudo o que procurarem, mas os menores ficarão impedidos de ver qualquer tipo de conteúdo sensível como pornografia ou violência.

Caso a identificação considere que o utilizador tem menos do que a idade mínima para utilizar o Discord, que em Portugal é 13 anos, mas pode subir até aos 16 dependendo do país, a conta será automaticamente bloqueada, podendo depois haver um recurso para o suporte da plataforma em caso de erro na análise automática.

Esta novidade ainda não está disponível em todas as regiões, mas o Reino Unido e a Austrália já receberam a primeira fase desta verificação de idade.

Lê as últimas novidades dos esports aqui.